El uso de Inteligencia Artificial (IA) en armas mortales, que se utilizan principalmente en la guerra, mantiene en alerta a expertos internacionales.

Los reguladores enfrentan una carrera contra el reloj para controlar la proliferación de máquinas de matar impulsadas por inteligencia artificial (IA), advirtieron expertos el lunes.

Con sistemas autónomos emergiendo en campos de batalla como Ucrania y Gaza, la decisión de atacar objetivos podría pronto recaer completamente en máquinas, advirtieron los observadores.

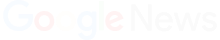

“Este es el Momento Oppenheimer de nuestra generación“, afirmó el ministro de Relaciones Exteriores de Austria, Alexander Schallenberg, comparando la situación actual con el legado de J. Robert Oppenheimer, quien abogó por el control de armas nucleares tras ayudar a desarrollar la bomba atómica en 1945.

Fusión de IA y Tecnología Militar: Desafíos y Riesgos

Oficiales de más de 100 países se reunieron en Viena para abordar cómo controlar la fusión de IA y tecnologías militares, un desafío exacerbado por el creciente conflicto global y los incentivos financieros para empresas que promueven la IA.

Jaan Tallinn, inversor en DeepMind Technologies, destacó la potencial falta de alineación entre los incentivos de Silicon Valley y los intereses de la humanidad.

“Los incentivos de Silicon Valley podrían no estar alineados con el resto de la humanidad”, advirtió Tallinn, subrayando la importancia de considerar las implicaciones éticas de la IA en el ámbito militar.

El Desafío de Regular la IA en Defensa

Los gobiernos están colaborando con empresas para integrar la IA en la defensa, con inversiones millonarias del Pentágono en startups de IA y proyectos de la Unión Europea para mejorar la evaluación de objetivos en el campo de batalla. Sin embargo, informes sobre el uso de IA en operaciones militares, como el programa “Lavender” de Israel, suscitan preocupaciones sobre el control de armas autónomas.

Israel ha sido objeto de críticas por el presunto uso de IA en operaciones militares, lo que ha avivado el debate sobre la regulación de armas autónomas y su impacto en los conflictos armados.

Perspectivas Futuras y Necesidad de Regulación

A pesar de los llamados a la acción, la implementación de soluciones diplomáticas puede ser un desafío a corto plazo, según Alexander Kmentt, principal oficial de desarme de Austria.

“Un enfoque clásico para el control de armas no funciona porque no estamos hablando de un único sistema de armas, sino de una combinación de tecnologías de doble uso”, dijo Kmentt a una entrevista, consigna Infobae.

Sin embargo, a largo plazo, se prevé que la facilidad de acceso a la tecnología conduzca a la necesidad de escribir nuevas reglas para mantener bajo control la proliferación de sistemas de armas autónomas.

La facilidad de acceso a la tecnología está cambiando el panorama de la seguridad internacional, lo que requiere una respuesta urgente y coordinada por parte de la comunidad internacional para regular las armas autónomas y garantizar la estabilidad global.

Enviando corrección, espere un momento...

Enviando corrección, espere un momento...